📍 간단 후기

🏷️ 수업

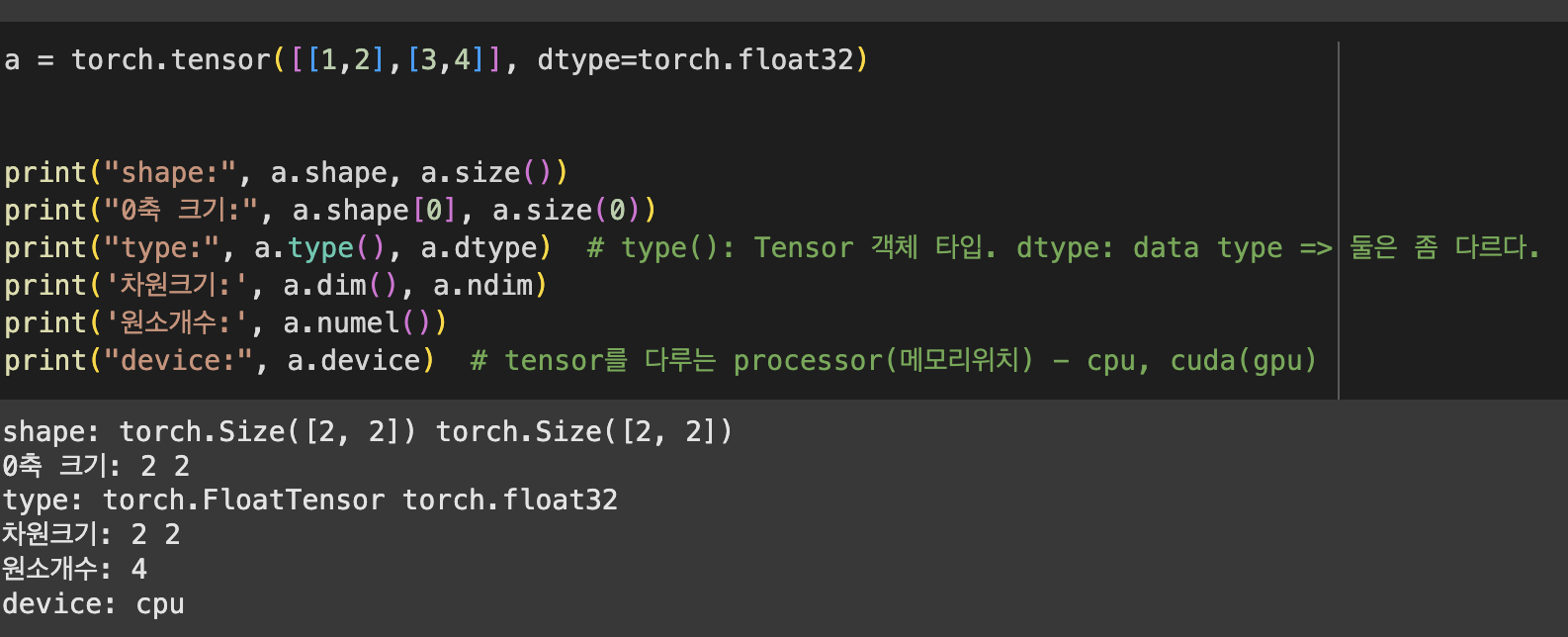

Pytorch를 다루기 시작했다. Tensor 단위의 데이터를 쓰기도 했고, 딥러닝 관련 내용이기도 하다. 그래서 기본적인 CPU부터 GPU차이부터 기본적인 환경을 다시 한번 상기했다. 또 Mac m칩에는 탑재되어 있지만, Windows 환경에는 GPU가 없기 때문에 COLAB을 사용하기 시작했다. 차원 수를 지정 및 변경해 보고, Weigths(가중치)에 따른 성능을 확인해 보며 실습을 진행했다.

📍 좋았던 점

- Tensor

Tensor라 하면 보통 단위를 떠올릴 것이다. (들어본 사람들은)

여기서는 Tensor 자체가 파이토치에서 데이터를 저장하는 자료구조로 생각한다. 물론 숫자 데이터 타입만 지원한다. 숫자 데이터 타입을 지원하다 보니, float이나 int 등과 같은 타입 지정도 가능하다. 대부분 numpy와 같이 dtype이나 item과 같은 method를 쓰기 때문에, 큰 이질감은 없었지만, 축의 위치나 차원 수가 중요하다는 부분이 크게 와닿았다.

- Linear Regressioin

사실 Linear Regression(선형 회귀), MSE(평균 제곱 오차), 등은 대학교 때 인공지능을 배운 분들이라면 익숙하게 들릴 것이다. 다만 필자의 경우는 3년 전이다. 2학년 이었다. 3학년 때에도 사용하긴 했지만, 기본적인 개념 자체는 기억이 가물가물했다.

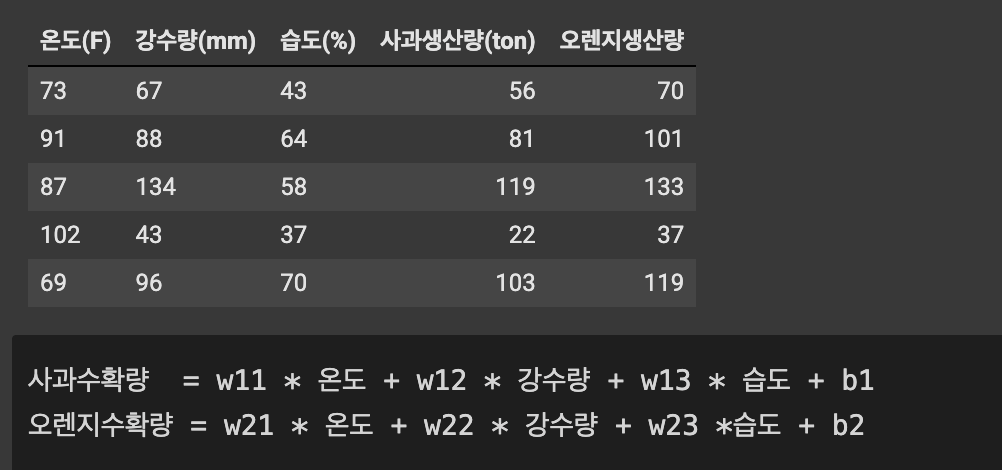

여기서 가장 중요한 부분은 아무래도 Weights(가중치)와 bias(편향)이라고 생각한다. 이 둘의 역할에 따라 원리가 작동이 되고, 정확한 예측이 가능해진다.

- Weights : 입력 데이터(입력층)에서 다음 노드로 넘어갈 때 계속 같은 값이면 매번 같은 결과가 나온다. 이를 방지하기 위해 Weights를 각기 다르게 곱한다.

- Bias : 가중합이라고도 한다. 하나의 노드에서 최종적으로 출력되는 값을 조절하기 위해 마지막에 더하는 값이다.

이 두가지 변수를 요소를 통해 보다 정확한 예측치를 파악할 수 있다는 사실을 다시 상기시킬 수 있었고, 배울 수 있어서 좋았다.

📍 부족한 점

- 다중 입력, 다중 출력

다중 입력에 따른 다중 출력을 하기 위해선, 합성곱을 실행해야 한다. 이를 위해 내적을 활용한다. 내적 자체를 이해하는 데에는 어렵지 않다. 다만 예측하는 모델의 정의 과정이 힘든 것이다. Weights와 Bias를 통해 세세하게 조절해 가며 지정해야 한다. 이때 중요한 요소가 차원이다. 입력할 feature 수와 출력할 feature 수를 고려해 차원 수를 맞춰야 올바른 예측이 이뤄진다.

이를 통해 MSE를 이용한 loss 계산도 진행해야 한다. 말 그대로 평균오차를 계산하는 것이다. 많은 데이터들이 예측을 위해 활용되지만, 손실되는 데이터도 분명히 존재하기 때문에, loss값 파악도 중요하다. 다른 말로는, loss 값이 가장 적은 parameter를 찾는 것이 주된 목적이다.

- 경사 하강법 - 손실 곡선의 기울기를 통해 손실값 계산 / 기울기는 손실값이 가장 크게 증가하는 방향을 향한다.

- 기울기를 줄이기 위해 hyper parameter인 learning rate를 바꾸어준다.

- 확률적 경사 하강법(SGD) - 수많은 데이터들 중 한 번에 하나 또는 일부 샘플을 사용해 Gradient를 계산하고 매개 변수를 업데이트 한다.

- ** Gradient : 경사 하강법에서 말하는 기울기 / 이를 줄이기 위해 (loss 손실을 줄이기 위해) parameter 변경

위의 최적화 알고리즘 등을 활용하여 딥러닝에 대해 더 정확히 파악해 볼 필요성을 많이 느꼈다.

📍 성찰 및 마무리

하루하루 듣는 수업 내용이 죄다 깊이 이해하지 못하면 따라가기 힘들 것 같다. 그냥 아무 생각 없이 따라가기만 할 것 같겠다는 생각이 들었던 한 주였다. 점점 CS에 대한 지식도 지식인데, 기존에 알던 지식들이 바닥을 보이는 것 같다. 앞으로 부족한 부분은 더 많이 물어보고 더 많이 찾아보고, 더 많이 적어보며 공부해 보는 시간이 필요할 것 같다.

점점 시간 분배에 힘이 든다는 생각이 든다. 다음 주나 다다음주부터 다가올 프로젝트, 그다음 주까지 제출해야 할 공모전, 꾸준히 해야 하는 코딩 테스트 준비에 있어 시간 분배를 어떻게 해야 할지 고민해 볼 필요가 있는 주이다.

부트캠프 자체가 본인이 한 만큼 얻어가는 거라고 하는데, 이렇게 바쁘다는 것은 얻어가는 것이 많다는 것이라 생각하고 끝까지 시간 부족하게 살아볼 필요성을 느꼈다.

'[SKN FAMILY AI CAMP] > 주간' 카테고리의 다른 글

| 🐉 SKN FAMILY AI CAMP 13기 8주차 후기 (2025.05.12 ~ 2025.05.16) (4) | 2025.05.16 |

|---|---|

| 🐉 SKN FAMILY AI CAMP 13기 7주차 후기 (2025.05.07 ~ 2025.05.09) (2) | 2025.05.09 |

| 🐉 SKN FAMILY AI CAMP 13기 4주차 후기 (2025.04.14 ~ 2025.04.18) (0) | 2025.04.18 |

| 🐉 SKN FAMILY AI CAMP 13기 3주차 후기 (2025.04.07 ~ 2025.04.11) (0) | 2025.04.14 |

| 🐉 SKN FAMILY AI CAMP 13기 2주차 후기 (2025.03.31 ~ 2025.04.04) (1) | 2025.04.04 |