📍 간단 후기

🏷️ 수업

LLM 파트에 들어선 만큼, 다양한 모델들이 존재했다. 이를 통합하기 위해 Langchain이 등장했다. 따라서 이번주 수업은 Langchain을 활용한 수업들을 진행했다. Huggingface나 Ollama에서 자료를 다운받아 사용하는 등 다양한 자료를 활용해 보았다. 또한 고대하던 RAG 수업을 진행했다. 아직 목요일, 금요일 이틀밖에 안배웠지만 정말 뜻깊었고, 호기심이 많이 생기는 파트였다. 다음주 수업이 더욱 기대되는 한주였다.

🏷️ 코딩 테스트 스터디

자료구조 중 스택과 큐, 덱에 대해서 학습을 진행했다. 관련 문제 풀이에 앞서, 개념에 대해서 다같이 정립하는 시간을 가졌다. 전공자는 다시 복기하는 느낌으로, 비전공자는 새로운 개념을 습득한다는 느낌으로 스터디를 진행하려고 노력했다. 다음주는 Brute Force(완전 탐색)에 관해서 문제를 풀어오고 개념을 확립할 계획이다.

📍 좋았던 점

- RAG

RAG는 검색하는 정보를 DB에서 꺼내와 답변을 생성하는 과정을 가진다. 따라서 정보 저장 과정은 위 이미지와 같다. 다음으로는 검색 및 생성을 진행한다. 사용자의 질문에 따른 답변 생성이 바로 이 과정에서 진행된다.

Prompt -> LLM -> Output 형태로 진행된다고 보면 된다.

예시 이미지가 RAG의 흐름이다. 사용자가 질문을 하면 시스템은 검색을 진행한다. 검색 진행과정이 네모박스 안의 과정인 것이다. Embedding model을 통해 Embedding vector를 생성한다. 이후 최종 vector값을 vector DB에 저장해 처음 사용자가 질문한 내용과의 유사도를 판단한다. 이후 prompt를 보내는 과정이 RAG의 전체 흐름이다.

- Memory

기본적으로 LLM은 입력 받을 수 있는 토큰 수에 제한이 있다. 그에 따라 질문을 무한정으로 전달하기에는 한계점이 존재한다. 또 LLM은 기본적으로 Stateless 모델이다.

*** Stateless : 비저장 상태

따라서 메모리를 통해 사용자의 이전 대화 상태를 기억하는 것이다. input prompt를 chain을 통해 ouput prompt로 결과를 도출한다. 해당 output을 memory에 넣어 다음 사용자의 질문과 합쳐서 chain에 넣는 방식을 "memory를 사용한다"라고 표현한다.

*** Chain : 여러 컴포넌트들을 정해진 순서대로 연결해 단계별로 자동화하는 작업 (prompt template | LLM_model | output parser)

📍 부족한 점

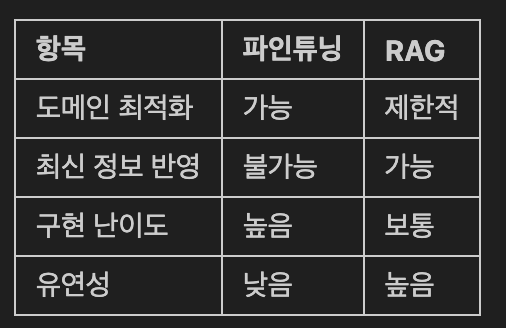

- RAG와 Fine Tuning

LLM은 학습 당시의 데이터만을 기반으로 작동하므로 최신 정보나 기업 내부 자료와 같은 특정 지식 기반에 접근하기 힘들다.

- 파인튜닝 : 대용량 데이터를 학습시키고, 이후 소량의 데이터로만 추가로 학습시켜 맞춤형 모델로 구축

- 장점 - 사용자에게 맞춤형 / 단점 - 모델 재학습에 많은 시간과 자원이 필요함. 새로운 정보 반영을 위해 모델의 재학습 필요

- RAG : 재학습 필요 없이 외부 지식 기반 정보를 검색해 실시간으로 답변에 활용해 Hallucination(환각 증상)을 줄인다.

- 장점 - 재학습 x, 모델 수정 x / 단점 - 검색 문서에 따라 정확성의 차이 존재. 검색 시스템의 구축 필요

RAG에서 중요한 개념 중 하나가 vector DB이다. vector DB는 앞에서 설명한 Embedding vector를 생성하여 저장하는 곳이라고 생각하면 된다. 여기서 핵심은 이를 통한 유사도 평가이다. 최종 vector 값을 DB에 저장하여 유사도를 파악하는 것이 핵심이다.

- 코사인 유사도

- 유클리드 거리

- 맨하탄 거리

위 3가지가 유사성을 판단할 수 있는 계산 기법이다. 이는 벡터 간의 거리를 측정하여 유사한 데이터를 빠르게 검색할 수 있도록 도와준다. 따라서 비정형 데이터(텍스트, 이미지, 보이스, 등)를 벡터로 변환하여 저장하고, 효과적으로 검색할 수 있도록 하는 것이다.

- Prompt Engineering

Prompt Engineering의 업무 자체에 대해서 궁금했었다. 뭔가 애매한 개념이라고 생각했다.

처음 한 생각 : 그럼 Prompt Engineering 작업은 단지 prompt를 정리하는 작업인가? 직접 학습하는 과정이 Engineering이 맞나?

이해 후 : 사용자가 애매하고 구체적이지 않게 질문을 해도 중간에서 질문에 맞는 프롬프트를 구체적으로 재생성하여 LLM에 전달하는 역할이 Prompt Engineering 작업이구나!!

간단하게 말하면 어떻게 질문하면 LLM 모델이 정확하게 답해줄까 하고 연구하는 작업을 뜻한다는 것이다.

📍 성찰 및 마무리

이번주 목요일에 코엑스에서 하는 STK2025에 다녀왔다. 최신 기술 동향 파악 및 배웠던 내용이 실무에서 어떻게 쓰이는지 보러 갔다. 결론은 대만족이다. 처음 가봤는데, 정말 다양한 기업이 참여했고, 다양한 이벤트 참여 부스 등이 있어 볼거리, 즐길거리, 얻을만한 지식 등을 봤을때 상당히 만족스러웠다.

전체적으로 부스를 돌아다녀 보니, RAG와 파인튜닝을 기반으로 서비스를 개발하는 것 같았다. 구체적으로 어떤 API를 쓰는지, 어떤 LLM 모델을 사용하는지,(거의 다 OpenAI거 쓰긴 했지만..) 등을 물어보고 들어보며 설명을 들으니 '아 나도 알아듣는 것이 생기고, 이쪽 업계에서 일하고 싶어 하구나. 재밌다' 하는 생각이 물씬 들었다.

뿌듯하면서도 알찼던 코엑스 탐방을 마치며 수업에 더 집중할 수 있었고, 알찬 시간을 보낼 수 있어서 좋았다. 이제 현실로 돌아와서 코테 스터디의 완전 탐색을 공부를 진행할 것이다. 다음 진행할 프로젝트에 맞춰 최신 기술을 어떻게 적용하면 좋을까 생각을 해보며 다음주를 기다려야 겠다.

+++ 일요일에 있을 LLM 특강 수업을 통해 AI 엔지니어 관련해서 길을 어떻게 정해야 할지 확실히 정해야 겠다.

'[SKN FAMILY AI CAMP] > 주간' 카테고리의 다른 글

| 🐉 SKN FAMILY AI CAMP 13기 14주차 후기 (2025.06.23 ~2025.06.27) (1) | 2025.06.28 |

|---|---|

| 🐉 SKN FAMILY AI CAMP 13기 13주차 후기 (2025.06.16 ~2025.06.20) (0) | 2025.06.20 |

| 🐉 SKN FAMILY AI CAMP 13기 11주차 후기 (2025.06.02 ~ 2025.06.05) (2) | 2025.06.05 |

| 🐉 SKN FAMILY AI CAMP 13기 9주차 후기 (2025.05.19 ~ 2025.05.23) (2) | 2025.05.23 |

| 🐉 SKN FAMILY AI CAMP 13기 8주차 후기 (2025.05.12 ~ 2025.05.16) (4) | 2025.05.16 |